正文摘要:

最近一段时间来,ChatGPT在全球引发了竞逐,国内的科技巨大也在准备自己的ChatGPT产品,中国工程院院士、阿里云创始人王坚日前发表了自己的看法,他认为国内已经具备了算力及技术基础,关键在如何爆发。在南方电网总部参加第四届电力调度AI应用大赛上,王坚院士表示,我国已经具备发展中国版ChatGPT的算力支撑和技术基础,问题的关键在于技术积累如何最终实现爆发。在Al、大模型等ChatGPT所需底层技术上,达摩院具备领先的技术能力,此前曾先后推出全球首个10万亿参数规模M6大模型、AI模型开源社区“魔搭”等,相关研究成果一直处于国际领先。中科院院士谈ChatGPT究竟是怎么一回事,跟随小编一起看看吧。

最近一段时间来,ChatGPT在全球引发了竞逐,国内的科技巨大也在准备自己的ChatGPT产品,中国工程院院士、阿里云创始人王坚日前发表了自己的看法,他认为国内已经具备了算力及技术基础,关键在如何爆发。

在南方电网总部参加第四届电力调度AI应用大赛上,王坚院士表示,我国已经具备发展中国版ChatGPT的算力支撑和技术基础,问题的关键在于技术积累如何最终实现爆发。

“在同样多年技术积累的基础上,谁的技术能积累到能够爆发的程度,这才是企业间的差异所在。”

王坚指出,工业是用新技术最好的地方。在电力行业、工业领域,我们可以找到比“下棋”更有高度的问题,引领下一波AI浪潮。

如果能找到、解好这样一个问题,对推动社会经济发展、人类生活变化,会产生更巨大、更积极的影响。

此前报道,阿里达摩院正在研发类ChatGPT的对话机器人,目前已开放给公司内员工测试。

从曝光截图来看阿里巴巴可能将AI大模型技术与钉钉生产力工具深度结合,能够在钉钉直接对话。

在Al、大模型等ChatGPT所需底层技术上,达摩院具备领先的技术能力,此前曾先后推出全球首个10万亿参数规模M6大模型、AI模型开源社区“魔搭”等,相关研究成果一直处于国际领先。

中科院院士谈ChatGPT相关阅读:

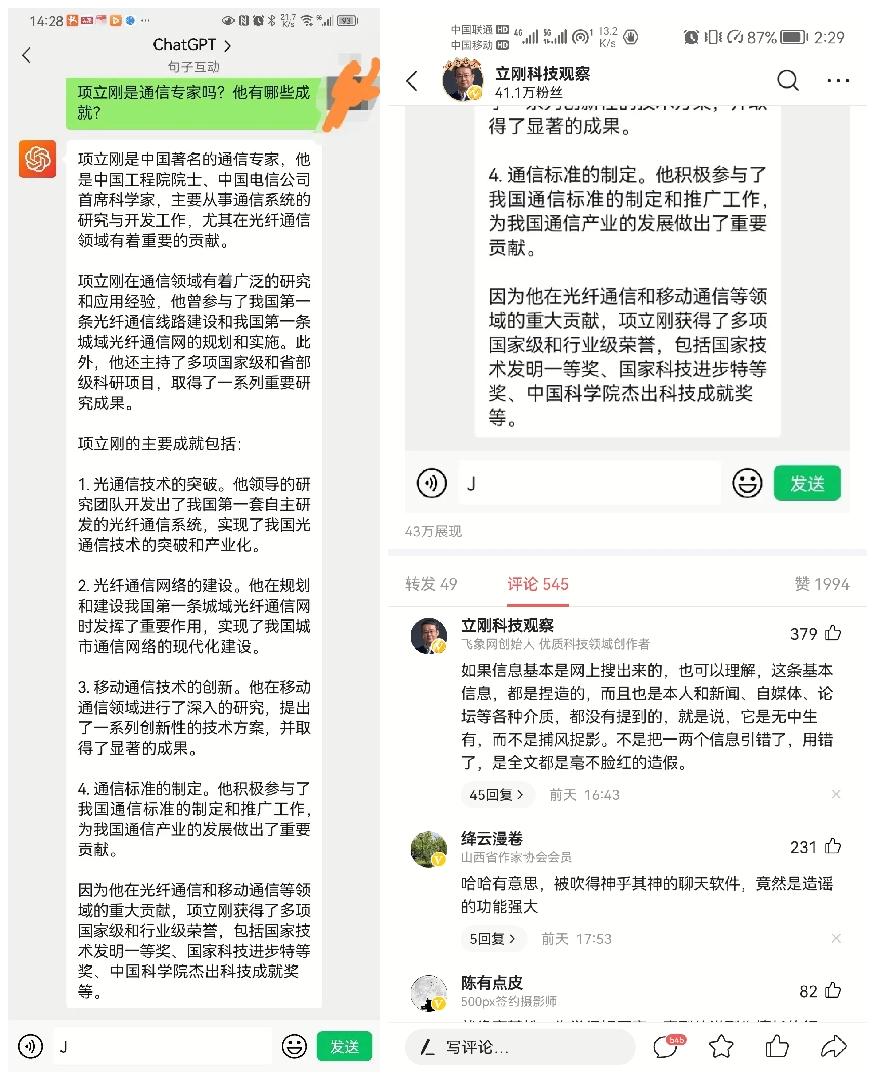

ChatGPT传谣说瞎话,项立刚主动打假:这样下去,什么是真话?

原创:湾区创业志

图源:网络

ChatGPT的发布,仿佛发生了一场大地震,已经被传得神乎其神,这东西不仅能写文章,编代码,还能写字,能画画。

在有些人看来,无论什么工作,都可以用ChatGPT来替代,AI淘汰人类已经是分分钟的事。

ChatGPT是不是真的那么厉害,最近飞象网创始人项立刚爆出的一则猛料,值得我们对这个现象级的AI产品,进行深度的思考。

ChatGPT的谎言

输入一个这样的问题:项立刚是通信专家吗?他有哪些成就?

ChatGPT的回答是:项立刚是中国著名的通信专家,他是中国工程院院士,中国电信公司首席科学家,主要从事通信系统的研究与开发工作,尤其在光纤通信领域有着重要的贡献。……

答案很长,具体内容请看截图。

正如项立刚老师自己说的:

如果信息基本是网上搜出来的,也可以理解,这条基本信息,都是捏造的,而且也是本人和新闻、自媒体、论坛等各种介质,都没有提到的,就是说,它是无中生有,而不是捕风捉影。不是把一两个信息引错了,用错了,是全文都是毫不脸红的造假。这样的信息如果不规范,任其流传,这不是谣言满天飞,对社会的公信力产生巨大冲击。这样下去,什么是真话?

ChatGPT对这个问题的回答实在是太假了,逼得项立刚不得不站出来为自己辟谣。原因在哪里?

ChatGPT并没有多么强大,连信息的真假性都分辨不出来。这让我们看到,虽然ChatGPT具有强大的功能,但是隐藏的危害也是巨大的,一个不断向我们提供虚假信息的工具,就算功能再强大,又有什么意义呢?

如果任其发展下去,到底会带来什么后果,没有人能够预估。

ChatGPT带来的社会信任危机

ChatGPT上线之后,引来一片欢呼,其中声音最大的就是自媒体。

从自媒体具备商业变现的价值之后,99%的自媒体从业者,再也不会努力创作原创性内容,而是通过抄袭和洗稿,拼命扩大内容的数量。

虽然通过抄袭和洗稿,形成的内容生产流水线,不需要思考和创作,但是还是需要人力来进行拼接和输入,人均产能非常有限,每人日均能敲出20篇文章基本已是人类极限。

虽然可以通过洗稿,发布虚假信息,恶意炒作,来获得流量红利,达到变现的目的。但是工作量很大,所以自媒体也做得很累。一直在寻找一个强大的生产工具。

ChatGPT,刚好符合这个需求,有了ChatGPT,生产内容就变得简单多了,只要输入一个标题,ChatGPT就能自动输出一篇内容,据说一分钟就能写一篇文章,这个效率是人工没办法比拟的。

但是现阶段的ChatGPT还没有思维能力,只具备在数据库中检索筛选输出的功能,就不可避免会输入很多不可靠的信息,上面项立刚老师的例子就是证明。

但是,自媒体从业者的生产激情,并不会因为大量虚假信息的产生而止步,反而海量内容带来的高额收入,激发了他们的积极性,沉迷于使用工具,让这种不可靠的信息越来越多。

这种信息的泛滥,当然会导致人们无法分辨真假,从而对所有的内容失去了信任,让网络中的真实信息也失去了意义,社会将陷入更深的信任危机。

ChatGPT将会让人失去学习和思考的能力

正如有些人说的,AI可以代替人的任何工作,可以写文章,可以写代码,可以做试卷。

那人类学习还有什么意义?只要把现在所有的数据,交给AI,让它去学习,然后再反馈给人类就可以了。

也许有一天,人类只要具体最基本的识字能力,就能通过AI获取任何的答案,这实在是太可怕了。

不要觉得这是危言耸听,自从有了搜索引擎之后,很多知识我们就不再去记忆,要用的时候打开搜索引擎就行了,正所谓“外事不决找谷歌,内事不决找百度“。

懒惰是人的本性,能够轻松获得的东西,绝对不会再去努力,ChatGPT能生成现成的答案,为什么还要去思考呢?

没有思考的需求,就失去了学习的动力,切断了创新的机会。人的物质生活越来越丰富,思维能力却变得越来越低下。

不过,这只是大部分的人想法,还有一小部分清醒的人,他们会借助ChatGPT这个工具,植入各种技术,开发大量的功能,引导人们的行为。

这些工具就像一双无形的大手,把所有人变成手中的提线木偶,听从他们的指挥,进而引导社会舆论,控制人们的思维意识。现在靠网络水军已经可以肆意控制舆论,何况比水军强大万倍的AI机器人。

到时候,就算还有少数清醒的人发出正确的声音,但是人工创作内容的速度,远远比不上AI生产内容的速度,在数量级的压制下,任何努力都是徒劳,就像一粒沙子永远改变不了洋流的走向。

那些掌握AI技术的企业和个人,可以让世界向他们既定的方向发展,得到他们想要的一切东西,包括掏空大家的钱包,甚至颠覆某一个国家。

最近ChatGPT的异常火爆,不就是OpenAI这家公司所希望的吗?

结束语

所有的先进科技都是一把双刃剑,既可以促进人类文明的发展,也可以对人类造成伤害。

关键在于人类是否能掌握控制权,当计算机具备自主思维的那一天,就像《水浒传》的洪太尉打开了伏魔之殿,不是人力所能控制的了。

你觉得呢?

郑重声明:本文非ChatGPT自动生成